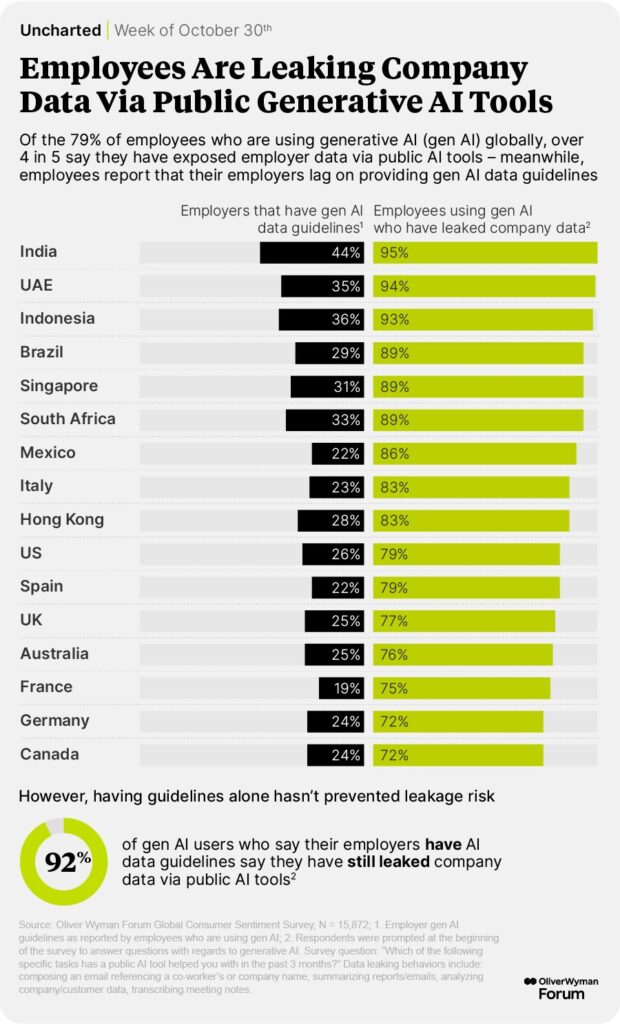

Vous utilisez ChatGPT, Gemini ou Claude pour aller plus vite, mieux rédiger, mieux analyser. Mais derrière ces gains de productivité se cache une réalité que peu d’organisations ont vraiment mesurée : chaque prompt est une potentielle fuite de données.

Une situation qui tire son origine de 2 facteurs : le modèle économique des outils IA et le manque d’encadrement au sein des organisations.

Un modèle économique fondé sur vos données

ChatGPT, Gemini, Claude : des outils accessibles gratuitement ou seulement pour quelques euros par mois. Pour des technologies entraînées sur des milliards de paramètres. Comment est-ce viable ?

La réponse est dans les conditions d’utilisation que personne ne lit : vos conversations alimentent leurs modèles. C’est le carburant de leur croissance. Et la prochaine étape pour plusieurs de ces plateformes est la publicité contextualisée : un modèle qui nécessite de vous connaître toujours mieux.

Gemini collecte aujourd’hui jusqu’à 22 types de données par utilisateur : localisation, historique des échanges, comportements de navigation. L’utilisateur qui pensait utiliser un outil devient, sans le décider vraiment, une source de données et une cible commerciale.

Des interfaces conçues pour créer la confiance

Le problème ne vient pas d’une mauvaise intention. Il vient de la conception même de ces interfaces, optimisées pour générer de la confiance et maximiser le temps passé.

Un ton délibérément humain. Ces IA ne répondent pas comme des logiciels. Elles reformulent, elles encouragent, elles relancent. D’après une étude de 2024, 16 % des adolescents utilisent ChatGPT comment un coach psychologique et lui partagent des informations personnelles qu’ils ne partageraient pas à leur entourage. Ce phénomène a un nom : l’anthropomorphisme. Et il a des conséquences très concrètes sur ce que vos équipes leur partagent.

Une mécanique de relance permanente. Chaque échange se termine par une nouvelle question, une invitation à aller plus loin. Le modèle est le même que celui des réseaux sociaux : vous garder sur la plateforme le plus longtemps possible, avec des informations de plus en plus contextualisées.

L’illusion de l’éphémère. Les anciens prompts disparaissent de l’interface. On les oublie. Mais eux ne disparaissent pas. Cette invisibilité est peut-être le levier le plus puissant — et le plus sous-estimé.

3 exemples de situations à risque

Trois situations représentatives, parmi des dizaines observées chaque semaine :

Une analyse marché stratégique. Un responsable marketing demande à ChatGPT d’analyser la concurrence pour un lancement produit — en précisant son entreprise, sa cible, son positionnement. En quelques lignes de prompt, il vient de livrer l’essentiel de sa stratégie commerciale à une plateforme tierce.

Un contrat sous NDA. Un juriste ou un dirigeant passe un accord client dans Gemini pour en corriger la formulation. Les clauses confidentielles, les parties, les montants — tout est désormais hors du périmètre sécurisé de l’entreprise.

Un dossier RH nominatif. Un manager demande de l’aide pour rédiger une lettre de rupture de contrat, en détaillant le nom du collaborateur, son poste, les faits reprochés. Au-delà du risque de confidentialité, c’est une violation directe du RGPD et de l’IA Act.

Ces situations ne sont pas des erreurs grossières. Ce sont des réflexes naturels, dans des organisations qui n’ont pas encore posé de cadre clair sur l’usage de l’IA.

Comment protéger vos données des LLMs

Un premier filtre simple à diffuser dans vos équipes : « Enverriez-vous cette information par e-mail à un inconnu ? » Si non, elle n’a pas sa place dans une IA grand public.

C’est un bon point de départ. Mais ce n’est pas suffisant pour un usage professionnel sérieux. Il faut aller plus loin : paramétrer les outils, anonymiser les données, clarifier ce que l’entreprise autorise ou non, et évaluer si les solutions grand public ont encore leur place dans vos usages sensibles.

Nous avons formalisé l’ensemble de ces pratiques dans une checklist conçue pour les DSI et dirigeants souhaitant reprendre la main sur l’IA et encadrer son utilisation, sans freiner leurs équipes.

Téléchargez la checklist et découvrez 4 bonnes pratiques pour encadrer l’usage de l’IA dans votre organisation, tout en gardant le contrôle sur vos données sensibles.

Télécharger la checklist